por alguien que usa solo una foto de ellos con un sistema de IA (inteligencia artificial) entrenado. Es una capacidad potencialmente preocupante antes de las elecciones presidenciales de EE. UU. de 2020, dada la esperada publicación de videos falsos de candidatos.

Científicos del Samsung AI Center en Moscú y el Skolkovo Institute of Science and Technology con sede en Moscú explicaron la hazaña en un artículo publicado esta semana en arXiv, un servicio académico de preimpresión en línea. Mencionaron que pudieron animar una o más fotos de personas entrenando primero un sistema de IA (inteligencia artificial) con un conjunto de datos de videoclip que contenía muchas celebridades para que pudiera identificar las vistas clave de la cara y aprender.

Después de eso, el sistema de IA (Inteligencia Artificial) pudo combinar esa familiaridad con una o más imágenes de una persona para crear un convincente videoclip estilo “cabeza parlante”.

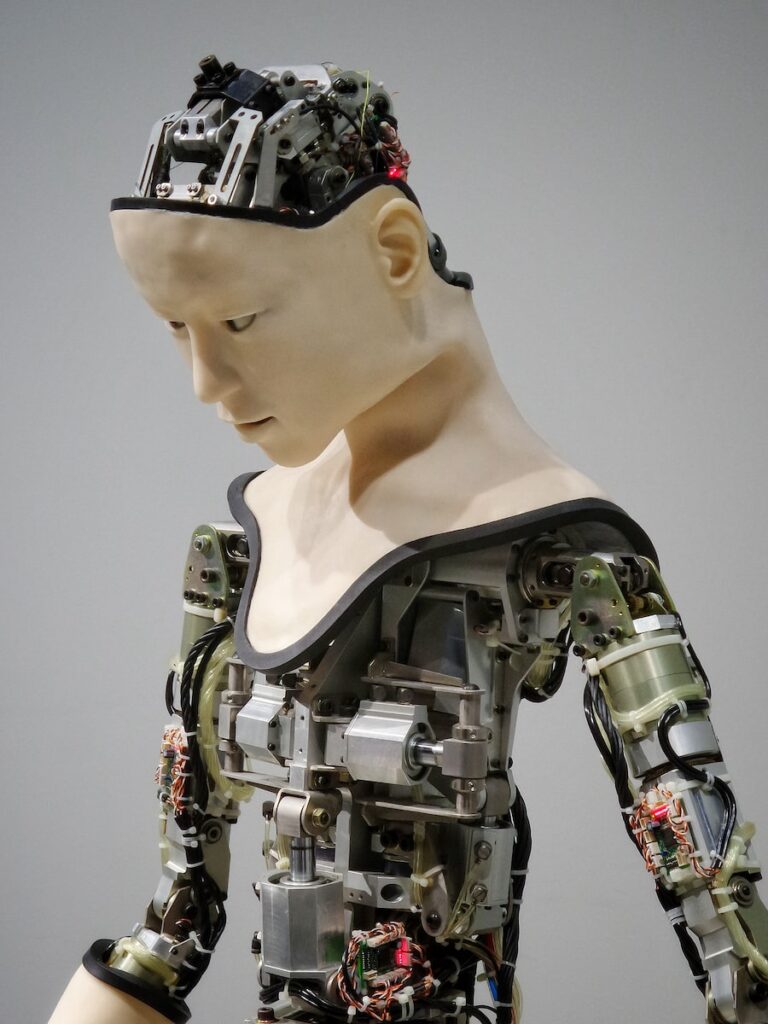

I.A

Un videoclip que los académicos publicaron en YouTube esta semana mostró varios ejemplos de cuán convincente puede verse y cuánto trabajo queda por hacer. Las llamativas variantes animadas del físico Albert Einstein, la actriz Marilyn Monroe y el pintor surrealista Salvador Dalí fueron provocadas por imágenes icónicas de ellos.

Pero a cada uno le faltaba algo: el peinado tupido de Einstein no se movía del todo con su cabeza, el bigote fino como un palillo de dientes de Dali era corto y el famoso lunar de Monroe faltaba en su mejilla. El trabajo es similar a los deepfakes, un híbrido de los términos «aprendizaje profundo» y «falso», que son clips de audio y video persuasivos falsos creados con tecnología de inteligencia artificial de vanguardia y son subjetivamente accesibles.

La sonda utiliza la misma técnica de IA que las falsificaciones profundas, una técnica de aprendizaje automático conocida como GAN, o Generative Adversarial Networks. Sin embargo, es diferente porque los deepfakes se crean mediante el uso de un videoclip de un objetivo junto con un videoclip de otra persona que se comporta como el objetivo en el clip en la boca del expresidente Barack Obama.

Edits con I.A

La proliferación de videoclips manipulados es una preocupación para todos, desde los líderes políticos hasta la American Wisdom Society, que temen que puedan usarse para mentir a los votantes. Dichos videoclips no necesitan ser alterados con la última tecnología para que sean efectivos: un video manipulado de la presidenta de la Cámara de Representantes, Nancy Pelosi, que se hizo viral esta semana, simplemente se ralentizó para que pareciera que arrastraba las palabras después de una reunión. con funcionarios estadounidenses, el presidente Donald Trump.

Avances

El trabajo de los académicos aún está en pañales: el sistema de IA (Inteligencia Artificial) solo ha sido entrenado para producir la cabeza, el cuello y los hombros específicos de un humano.

Y mientras un clip hecho con una sola foto insinuante de una mujer pretendía ser plausible (aunque en baja resolución), otros clips hechos con 8 y 32 fotogramas de ella parecían progresivamente más realistas. Siwei Lyu, quien estudia deepfakes y es director del Laboratorio de Aprendizaje Automático y Perspectivas de PC en la Universidad de Albany, SUNY, le dijo a CNN Business que el hallazgo podría facilitar la creación de deepfakes con menos datos de los que se necesitan actualmente.

En estos días, eso suele ser más de 30 segundos de videoclip tanto de la persona que desea manipular como de otra persona que también debe ser filmada realizando los movimientos deseados. «La desventaja es que sin datos suficientes, la calidad de la síntesis es limitada», dijo. Aunque sí quiere mencionar que también identificó el lunar perdido de Monroe.